Vetëvrasjet: A do të ndihmojë inteligjenca artificiale për parandalimin më të mirë të rrezikut?

Në rast të krizës vetëvrasëse, është e nevojshme të reagosh shumë shpejt për të ulur nivelin e vuajtjes emocionale të personit të prekur dhe për të shmangur veprimin. Zhvillimi i aplikacioneve digjitale dhe i inteligjencës artificiale mund të ndihmojë në zbulesën më të mirë të sinjaleve paralajmëruese, dhe të vendosë shpejt një ndihmë të përshtatshme, në kohën e duhur.

Vetëvrasja është pjesë e sfidave më komplekse – dhe më të dhimbshme – që përgjegjësit për shëndetin publik duhet të përballen. Një nga vështirësitë kryesore në parandalimin e veprimeve të tilla është të zbulohet vuajtja në momentin që ndodh dhe rrezikon të shndërrohet në veprim. Në fakt, mendimet vetëvrasëse dhe sjelljet që lidhen me to janë të vështira për t'u zbuluar përmes pyetësorëve klasikë, për shkak të shpejtësisë së tyre: ato mund të mos ndodhin gjatë konsultimeve mjekësore ose psikoterapeutike.

Ndërsa mjetet digjitale tani përdoren gjerësisht nga shumë prej nesh për krejtësisht të monitorojnë disa parametra të shëndetit të tyre (cilësia e gjumit, numri i hapave të bërë çdo ditë, monitorimi i kohës së ekranit…), studiuesit fillojnë të mendojnë për përdorimin e tyre për të kuptuar më mirë shëndetin mendor.

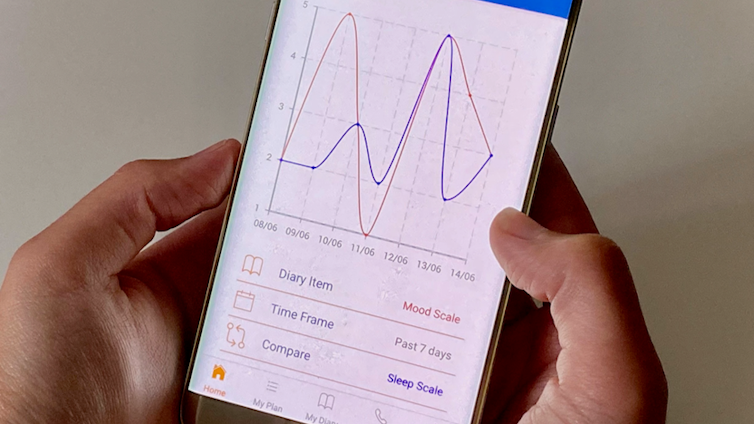

Një nga këto qasje, e quajtur « vlerësimi ekologjik i momentit (EMA) », përfshin mbledhjen në kohë reale të të dhënave mbi humorin, mendimet, sjelljet dhe mjedisin të një personi duke përdorur një smartphone ose një pajisje të lidhur. Këto informacione mund të futen manualisht (EMA aktive) ose të mblidhen automatikisht nga sensorët (EMA pasive).

Studimet kanë treguar se EMA mund të përdoret në mënyrë të sigurt për monitorimin e rrezikut për vetëvrasje, një term që përfshin një gamë të gjerë situatash, nga mendimet për vetëvrasje deri te veprimi. Hulumtimet e kryera tek të rriturit kanë zbuluar veçanërisht se ky lloj monitorimi nuk rrit rrezikun e përmendur. Ai, përkundrazi, lejon një interpretim më të hollësishëm dhe të individualizuar të përjetimeve të një personi, në çdo kohë. Por konkretisht, si mund të ndihmojnë këto të dhëna për të parandaluar një veprim të tillë?

Intervenime të personalizuara

Një nga përdorimet më premtuese të këtyre teknologjive është vendosja e intervenimeve adaptuese: përgjigje të personalizuara, në kohë reale, transmetohen drejtpërdrejt në telefon ose në pajisjen e personit të përfshirë. Për shembull, nëse të dhënat e mbledhura tregojnë një gjendje stresimi, pajisja mund t’i sugjerojë përdoruesit të ndjekë një hap të planit të tij të sigurisë.

E zhvilluar paraprakisht me një profesionist të shëndetit mendor, në një moment kur personi ndihet mirë, plani i sigurisë është një mjet që ka provuar veten në parandalimin e vetëvrasjes. (Bëhet fjalë për një listë udhëzimesh të shkruara, që përmbledhin strategjitë për t’u ndjekur në rast krizë vetëvrasjeje dhe kontaktet për t’u kërkuar ndihmë, me qëllim mbështetjen dhe udhëzimin e personit në mënyrë që ai të kalojë kulmin e intensitetit emocional që mund ta çojë në rrezik për jetën, shënim i redaksisë.)

Efikasiteti i një plani të tillë varet gjithashtu shumë nga qasja në kohën kritike. Falë këtyre intervenimeve digjitale, mbështetja mund të vendoset menjëherë, në mjedisin e vetë personit.

Megjithatë, shumë pyetje mbeten pa përgjigje. Cilat janë ndryshimet në të dhënat e regjistruara që duhet të shkaktojnë një alarm? Kur duhet të ndërhyhet? Çfarë forme duhet të marrë kjo ndërhyrje?

Pikërisht për këto lloj pyetjesh, inteligjenca artificiale (IA), dhe veçanërisht teknologjitë e mësimit të automatizuar, mund të ofrojnë përgjigje.

Rezultate inkurajuese pavarësisht disa kufizimeve

Mësimi i automatizuar tashmë përdoret për modelimin e rrezikut për vetëvrasje, duke identifikuar sinjale të dobëta në emocionet, mendimet ose sjelljet e një individi. Ai gjithashtu është përdorur për parashikimin e normave të vetëvrasjeve në shkallë të popullsive të plota.

Këto modele japin rezultate të mira në të dhënat mbi të cilat janë trajnuar. Por disa kufizime mbeten. Mbrojtja e privatësisë është një prej tyre, veçanërisht kur bëhet fjalë për të dhëna nga rrjetet sociale ose të dhëna personale.

Një pikë tjetër e vëmendjes: mungesa e diversitetit të të dhënave të përdorura për trajnimin e modeleve dëmton përgjithësimin e tyre kudo në planet. Një model i zhvilluar në një vend ose kontekst mund të jetë i vështirë për t’u përshtatur në një tjetër.

Pavarësisht kësaj, kërkimet tregojnë se këto modele parashikuese tejkalojnë mjetet tradicionale të përdorura nga klinicistët. Prandaj, në Mbretërinë e Bashkuar, rekomandimet klinike për shëndetin mendor tani i inkurajojnë këta të fundit të shmangin vetëm shkallës së rrezikut për të zbatuar një qasje më të butë, të fokusuar te personi; me fjalë të tjera, të bazuar në dialog dhe bashkëndërtimin e zgjidhjeve me individin e përfshirë.

Parashikimi, saktësia dhe besimi

Gjatë kërkimeve të mia, kam analizuar punimet kërkimore mbi vetëvrasjen që kanë vlerësuar efektivitetin e përdorimit të kombinuar të IA dhe EMA. Shumica e këtyre studimeve ishin mbi persona të ndjekur në spital ose në klinikë të shëndetit mendor. Në këto kontekste, EMA lejonte parashikimin e shfaqjes së mendimeve vetëvrasëse pas daljes nga institucioni.

Si nombre i publikimeve shkencore që kam analizuar përgëzonte saktësinë e modeleve të tyre, vetëm disa prej tyre treguan normat e gabimeve të arritura – veçanërisht gabimet pozitive të rreme (njoftimi i gabuar i një rreziku) ose gabimet negative të rreme (moszbardhja e një rreziku të vërtetë). Për ta adresuar këtë, ne kemi zhvilluar një udhëzues të praktikave të mira. Ndiqja e tij duhet të lejojë përmirësimin e qartësisë dhe rigorozitetit të studimeve të ardhshme.

Ka një fushë tjetër premtuese në përdorimin e IA-së: përdorimi i saj si një mjet ndihmës vendimmarrjeje për profesionistët e shëndetit mendor. Duke analizuar grupe të mëdha të dhënash nga shërbimet e kujdesit, modelet e IA-së mund të orientojnë praktikantët për të parashikuar zhvillimin e një pacienti dhe për të përcaktuar trajtimet më të përshtatshme për të.

Kushti sine qua non, megjithatë, është që profesionistët të kenë besim tek këto teknologji. Për këtë, këto sisteme nuk duhet vetëm të ofrojnë një përgjigje: gjithashtu duhet të jepet arsyetimi që çoi në atë përgjigje tek mjekët (flitet për « IA të shpjegueshme »). Duke kuptuar më mirë mënyrën se si funksionojnë këto mjete, praktikanët do të jenë në gjendje t’i integrojnë më mirë në praktikën e tyre, siç janë pyetjet klinike.

Vetëvrasja është një problem global, por përparimet në fushën e IA-së dhe ndjekjes në kohë reale hapin perspektiva të reja. Këto mjete nuk janë një zgjidhje magjike, por mund të ofrojnë ndihmë më të shpejtë dhe më të përshtatshme sesa mjetet aktuale, sidomos në situata ku deri tani kjo nuk ishte e mundur.

Për më shumë informacion

Mendimet vetëvrasëse janë një shenjë alarmi që duhet marrë shumë seriozisht.

Nëse ju (ose një nga të afërmit tuaj) jeni i/e shqetësuar, telefononi në 3114 (numri kombëtar i parandalimit të vetëvrasjes, thirrje falas dhe konfidenciale, 24 orë në ditë/7 ditë në javë).

Në rast rreziku të menjëhershëm për vetëvrasje, telefononi në SAMU (15) ose në 112 (numri evropian).

Për t’iu përgjigjur pyetjeve mbi krizën e vetëvrasjes, janë në dispozicion shumë burime online, duke përfshirë:

- për faillës 3114.fr për parandalimin e vetëvrasjes ;

- për faqen e faqes CléPsy, e dedikuar mendimeve vetëvrasëse dhe mënyrat për të ndihmuar fëmijët që janë viktima të tyre ;

- për faqen e faqes Ameli, e dedikuar parandalimit të krizës vetëvrasëse.

Informacion mbi burimin dhe përkthimin

Ky artikull është përkthyer automatikisht në shqip duke përdorur teknologjinë e avancuar të inteligjencës artificiale.

Burimi origjinal: theconversation.com